发展中国版ChatGPT,国内生态面临哪些挑战?

2023年4月3日 16:15 电子发烧友 6742随着ChatGPT爆火,国内地方政府、科研机构、科技企业纷纷表示,已经着手类ChatGPT大模型技术的研究和推进,这是一件具有长远战略意义的事。

然而大家都知道,这中间还面临着很多问题。比如算力,目前国内大模型的训练基本以英伟达为主。在日前某人工智能大会上,商汤科技联合创始人、大装置事业群总裁杨帆谈到,现在中国市面上A100全部加在一起,可能够支撑100个类ChatGPT大模型网络。听上去很多,然而一些大公司,可能需要把几千的卡连在一起,做内部更前瞻的测试,比如三千个卡做一个集群,要两三个这样的集群。整体来看,算力的体量是远远不够的。

发展中国版ChatGPT,国内生态面临哪些挑战?

发展中国版ChatGPT对于整个人工智能产业来说,是非常有前景的好事,然而它也反映出,在这个产业中还存在很多挑战,需要大家一起去解决。比如,现在国产芯片和软件是否能够支撑千卡以上的大规模集群,在吞吐率上是否能够与英伟达媲美。

过去这些年感觉上,中国在人工智能产业的应用上跑得很快,然而在基础技术上是落后美国的,如果要长远发展,势必要建设国产生态。这次ChatGPT的出圈,更是凸显出建设国产生态的重要性。

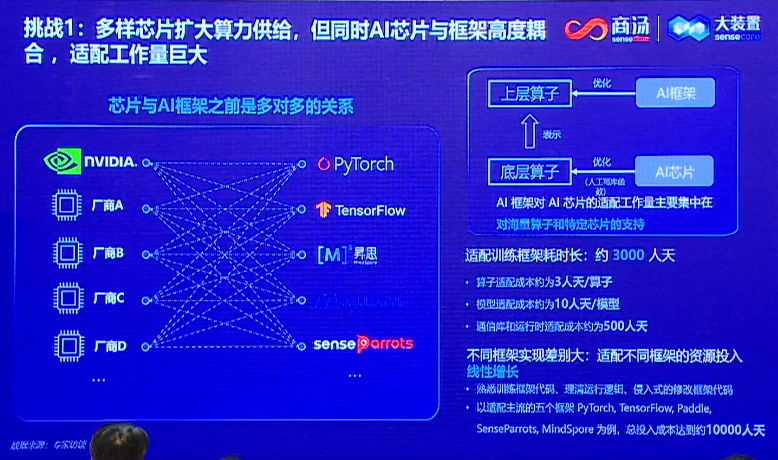

那么目前国产生态面临哪些问题呢,杨帆谈到了几点:第一,现在市面上确实已经出现多样化的AI芯片,去尝试挑战英伟达的统治地位,然而多样化的AI芯片,也带来它特有的挑战。就是说,国内现在有非常多的芯片,也有非常多的框架,这就形成了一个多对多的网状关系,而英伟达对PyTorch则是形成了一个强强联手的生态。

国内这种群狼乱战的状态就造成了适配工作量大,成本高的问题,包括算子的适配成本、框架的适配成本等。在杨帆看来,业界需要形成软硬件之间适配的行业标准,来降低整个生态在这个过程中的发展成本。

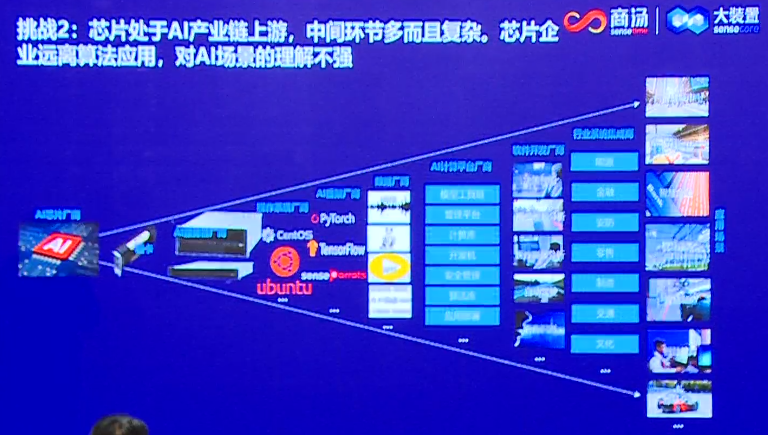

第二,芯片处在人工智能产业链上游,这到应用端,中间还包括板卡、服务器、操作系统、框架、数据、AI计算平台、软件开发、行业系统集成等各种厂商。现在人工智能整体来说还是一个不成熟的行业,算法几乎每天在更新,软件也每个月有更新。在这种情况下,各层很难有一个稳固的连接关系,去服务好下游厂商。

杨帆认为,AI芯片的开发周期本身就很长,要想在算力上去跟英伟达拼其实很难,因此芯片厂商最好是能够围绕需求进行下一代芯片的设计和优化,这样至少能够在细分赛道形成快速的超车。当然这就需要对应用有很好的了解,而从产业链条来看,芯片厂商距离应用端很远,如何去解决这个问题呢?

针对上述提到的生态建设面临的两个问题,商汤提出了相应的解决方案。据杨帆介绍,对于多元框架,多元芯片,公司希望跟业内的伙伴一起推动标准化的接口;对于链路长,对AI场景的理解不强的问题,商汤科技本身在算法和应用上有很深的积累,希望能够跟业内的伙伴一起,针对一些重要的、有大规模需求的场景,点对点把下游的场景打通,真正的去实现国产芯片的落地应用。

如何构建算力生态?

燧原科技创始人、COO张亚林认为,AI生态爆发的要素,包括算法、算力、数据、平台和应用。如何把生态五要素的飞轮转起来呢,他认为,需要以底层算力作为应用支撑,以数据和算法作为大模型的根基,以云服务和整个分布式框架作为平台,最后牵引出应用场景。

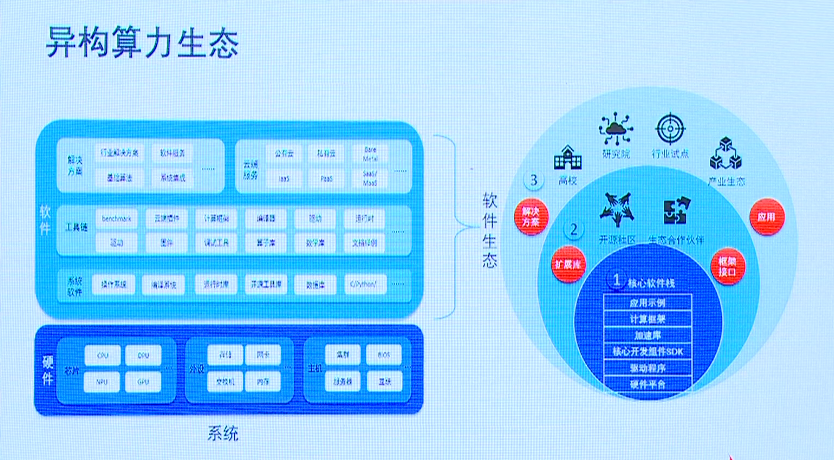

在当前的背景下,中国AI芯片和大算力企业,需要携手构建一个异构的算力生态。从下图来看,这个算力生态,从左边的系统角度,包括软件和硬件,软件软件有很多解决方案、云服务、工具链、系统软件;硬件有芯片、外设、主机等。右边三个圈是一个由内而外生态的扩张,国内任何一个算力联盟,想做好这件事情,必须打造好自己的核心软件栈,也就是类CUDA的一套底层软件栈;然后在上面,长出一个扩展库、框架接口,以跟开源社区和生态合作伙伴联力;再在上面牵引出的解决方案和各行各业的应用,包括高校、研究院、行业试点。

张亚林认为,从最底层的算力和软件栈,往上扩展到开源社区和合作伙伴,再往上牵引出更多应用,是现在中国算力和生态发展的必经之路。

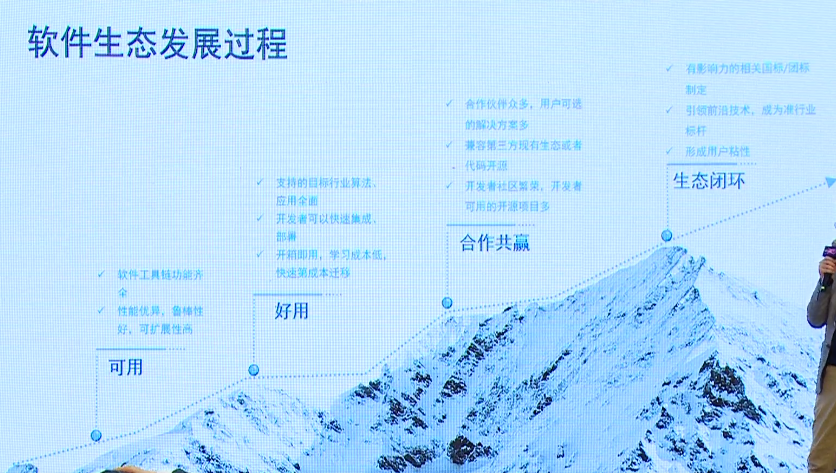

中国的软件生态要能够逼近英伟达,需要经历四个过程,从可用,好用,合作共赢,到生态闭环。目前中国绝大部分的AI芯片和软件栈,还处在可用或者是迈向好用的阶段。企业需要不停的进行产品迭代,不停的进行应用场景的迭代,让产品从可用变成好用。等到好用之后,客户群会开始扩张,形成合作和生态联盟,然后达成生态的闭环。

小结

最近大热的ChatGPT不仅仅是搜索引擎的加强版,也不仅仅是一个聊天机器人,它通过SaaS(软件即服务)方式所提供的人工智能服务,将重塑所有的数字化应用和所有行业,为人们带来一场新的工业革命。

ChatGPT的出现带来了机会,也反映出了国内在人工智能产业生态构建上的欠缺,如何通过发挥科研机构、大型科技企业的优势,结合产业链各细分领域的力量,构建完善的生态体系是当下业界需要共同探讨和解决的事。